HoloLensに関するイベントとしては、おそらくHoloLensミートアップが日本最大級だと思います。これまではオフラインで開催されていましたが、昨今の事情により今回はVR空間で開催されることになりました。

今回のイベントは、VR空間で300人近くの人が参加する大規模なものでした。各講演がとても勉強になりましたので、今回の内容をまとめてみました。

- 1.HoloLensミートアップとは?

- 2. 講演

- 2.0 前説&「HoloMagiciansの歩み」

- 2.1. 一枚の人物写真から3Dモデルを生成する「PIFu」で遊んでみた話

- 2.2 xRコミュニティの変容予測と提言

- 2.3 大阪駆動開発ってなんやねん

- 2.4 World Locking Toolsを調べているお話

- 2.5 AR KOBEのご紹介

- 2.6 コミュニティ紹介と最近のオンライン活動

- 2.7 Microsoft公式のHololensドキュメントを読もう!

- 2.8 KumaMCNの紹介

- 2.9 HoloLensでSF世界を作ろう

- 2.10 Azure Spatial Anchors 入門

- 2.11 これからはじめるAzure Kinect

- 2.12 HoloLens2 TutorialをMobileARで動かす

- 2.13 Special Session!「MRTK's recent updates」

- 3. (2020/4/24 追記) clusterで数百人規模のイベントに参加したときの気付き事項

- 4. おわりに

1.HoloLensミートアップとは?

HoloLensミートアップは、2017年から不定期に開催している勉強会です。HoloMagiciansというコミュニティで開催されており、メンバーは2020/4/22時点で2963人です。

参考:https://hololens.connpass.com/event/172236/

会場はclusterです。clusterとは、VR空間を使ったイベントができるサービスです。詳しくはこちらをご覧ください。

2. 講演

2.0 前説&「HoloMagiciansの歩み」

発表者:蜜葉 優氏 @mitsuba_yu、伊藤武仙氏 @takesenit、森真吾氏

イベント主催者の方からの開始前注意や、HoloMagiciansの歩みなどの説明がありました。

www.slideshare.net

2020/5/5追記

主催の@morioさんの記事です。

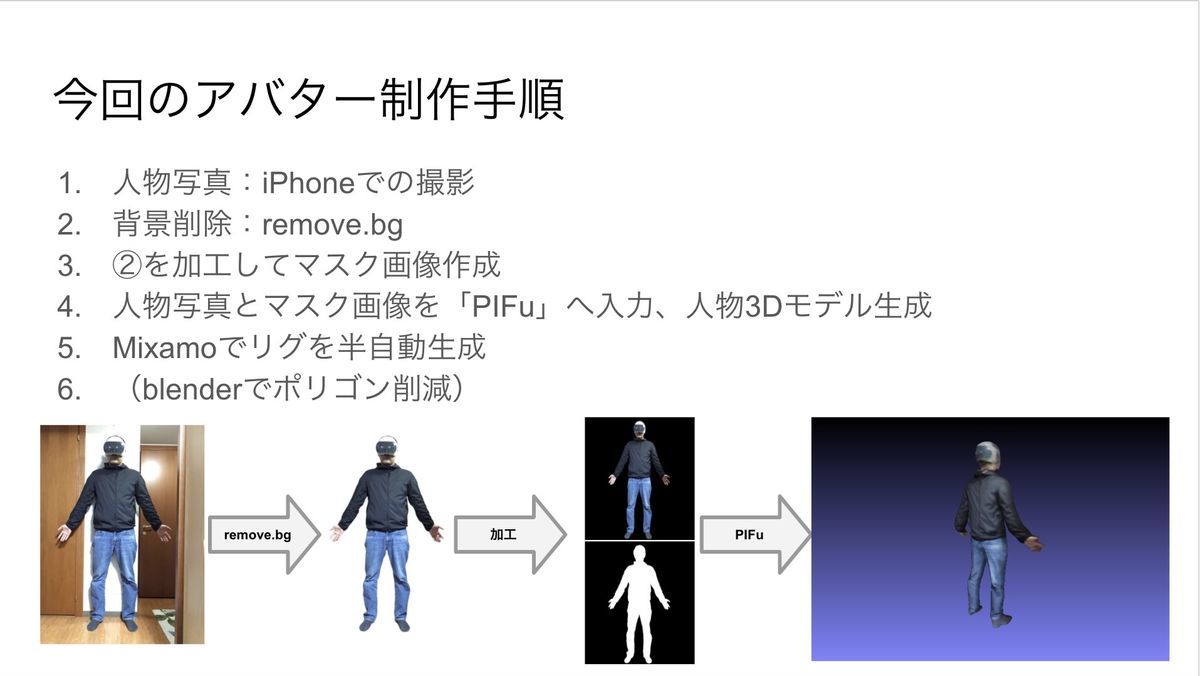

2.1. 一枚の人物写真から3Dモデルを生成する「PIFu」で遊んでみた話

発表者:miyamo 氏 @DMiyamo3

PIFuとは、Pixel-Aligned Implicit Function for High-Resolution Clothed Human Digitizationの略で、1枚の写真から3Dモデルを作る研究だそうです。ソースコードが公開されています。

人の写真だけでなくイラストからも3Dモデルの生成ができるようです。発展が楽しみな技術ですね。

2.2 xRコミュニティの変容予測と提言

発表者:じゅん氏 @jun_mh4g

概要です。

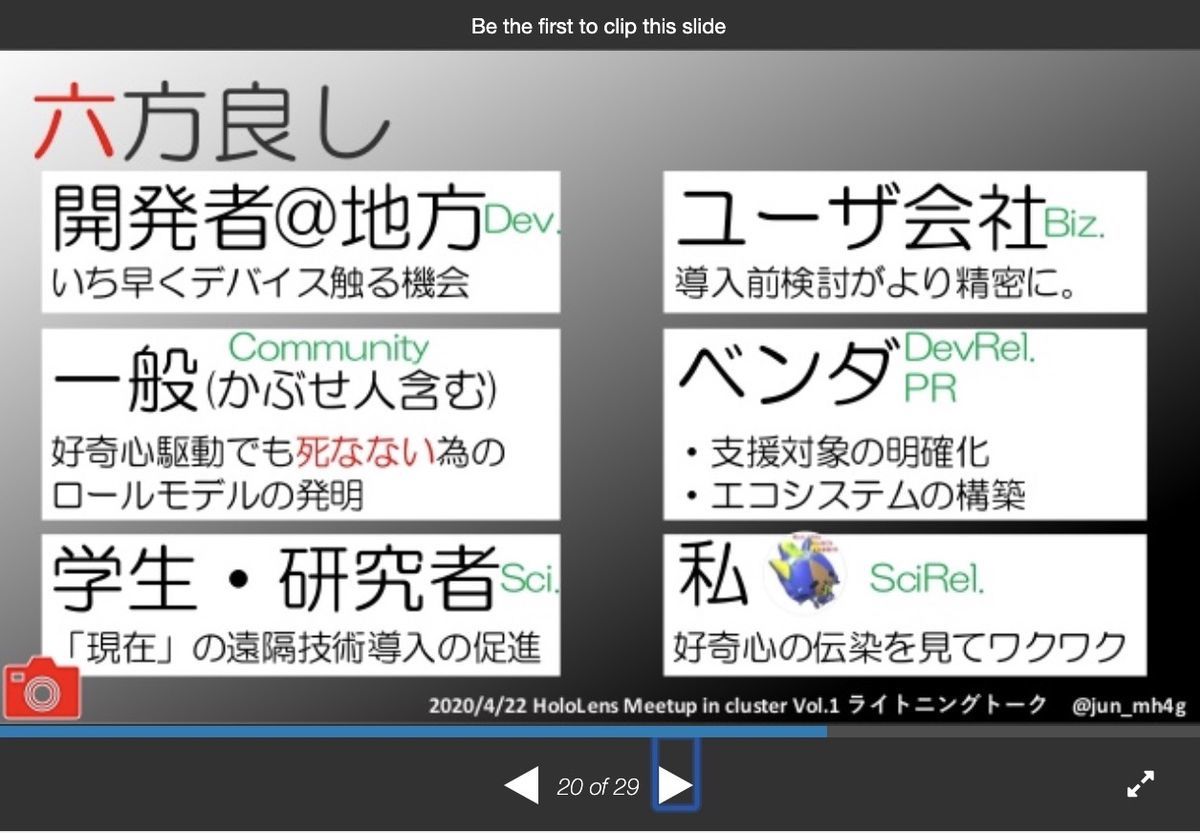

・これまではオフラインでつながってからコミュニティを作ることが多かったが、COVID19の社会構造変化によって、集まることが難しくなった

・提言:「やる気のないMRアンバサダー」を設立。個人がHoloLens2被せ人を担当して、広めていく。好奇心ベースで動いてコミュニティを活性化してくれた人が活躍できるようにしたい

「やる気のないMRアンバサダー」の設立メリットを1枚にまとめたスライドがありましたので、こちらが参考になるかと思います。

2.3 大阪駆動開発ってなんやねん

発表者:山地直彰氏

タイトルの答えとして、Connpassの説明を引用します。

大阪駆動開発は関西(主に大阪)を中心に、IT系のおもしろそうなことを試して取り組むコミュニティです。

大阪駆動開発では以下のカテゴリの活動が活発でそれぞれの技術領域に興味を持つエンジニア同士でミーティングやハンズオン等を実施しています。また、各種ハッカソンの運営なども手掛けています。

発表では主なイベント(勉強会、ハッカソンなど)を紹介されていました。 詳しくは大阪駆動開発のHPをご確認ください。

また、テレビや新聞などのメディアで紹介されたこともあるようです。

ちなみに、発表者の方はスマートフォンを使ったARヘッドセット「だんグラ」の社長も務めていらっしゃいます。

2.4 World Locking Toolsを調べているお話

発表者:宮浦恭弘氏 @takabrz1

www.slideshare.net

World Locking Toolsとは、広域の空間で3Dモデルを共有する仕組みです。以下の公式サイトに説明があります。発表者の宮浦さんも検証中とのことです。

Welcome! | World Locking Tools for Unity Documentation

HoloLensで空間マッピングを作りながら空間情報を解析し、Space Pinとして固定する仕組みのようです。既存のHoloLensは自分の周辺の空間しか保存していませんでしたが、Space Pinによって歩きながら空間情報を保存していくことができます。

Spatial Anchorsは異なるデバイスでもAR (MR) を共有できるのが利点ですが、Azureを介さないと使えません。おそらくWorld Locking ToolsはHoloLens2単体でできるはずで、空間共有の方法としてよいのだと思います。

2.5 AR KOBEのご紹介

発表者:堀尾風仁氏 @Futo_Horio

AR KOBEとは、HoloLensを中心としたミートアップを行うコミュニティです。スライドにある通り、全国各地から登壇者、参加者を募集中とのことです。

この発表では、後半でHoloLens2の新機能「Scene Understanding」の紹介もされていました。

下記の公式ドキュメントにありますが、Scene Understandingとは、Spatial Mappingした結果から、メッシュを作り、AI推論によって壁、テーブルのような識別ができる仕組みです。

細かい構築手順はこちらにまとめてくださっています。

2.6 コミュニティ紹介と最近のオンライン活動

発表者:ながみね氏 @KzoNag

ながみねさんが参加されている福岡XR部の紹介です。福岡XR部についてはこちらに詳しく書かれています。

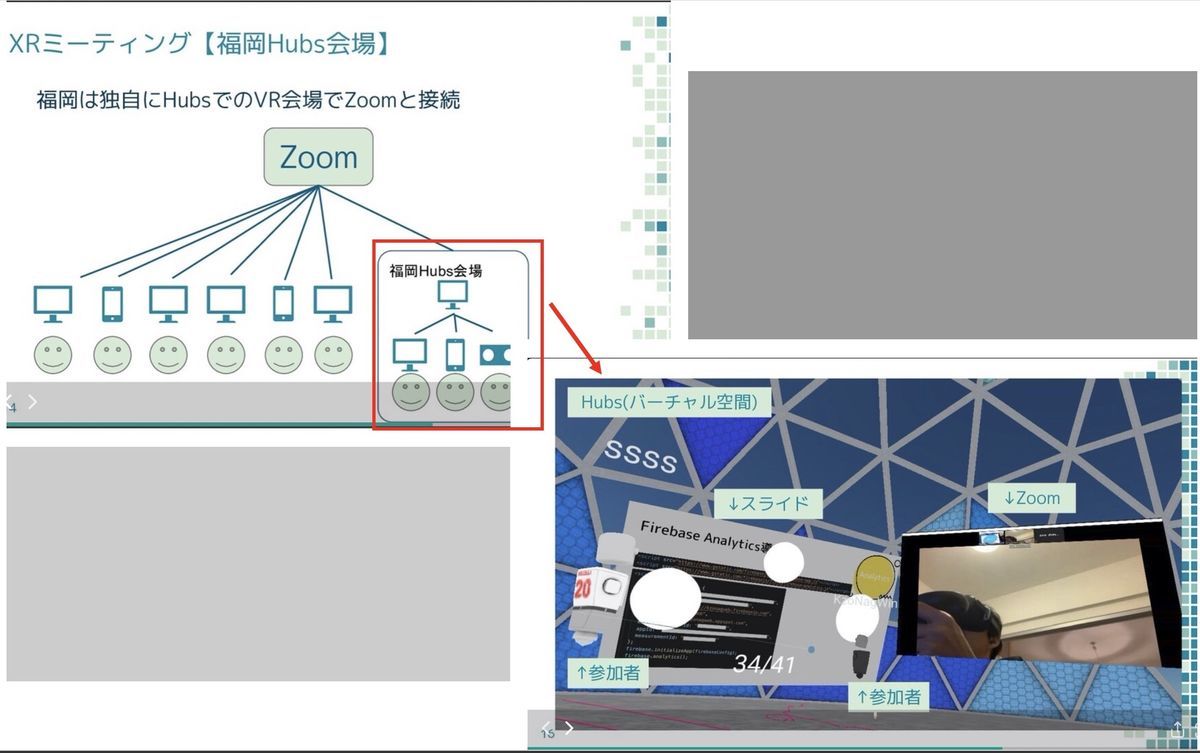

発表では、福岡XR部の最近の活動例として、オンラインイベントの工夫のお話がありました。最近、ZoomやTeamsでオンラインイベントをすることが増えているかと思いますが、福岡XR部ではZoomで開催しつつ、VR空間も組み合わせてみたとのことです。

スライドの抜粋です。

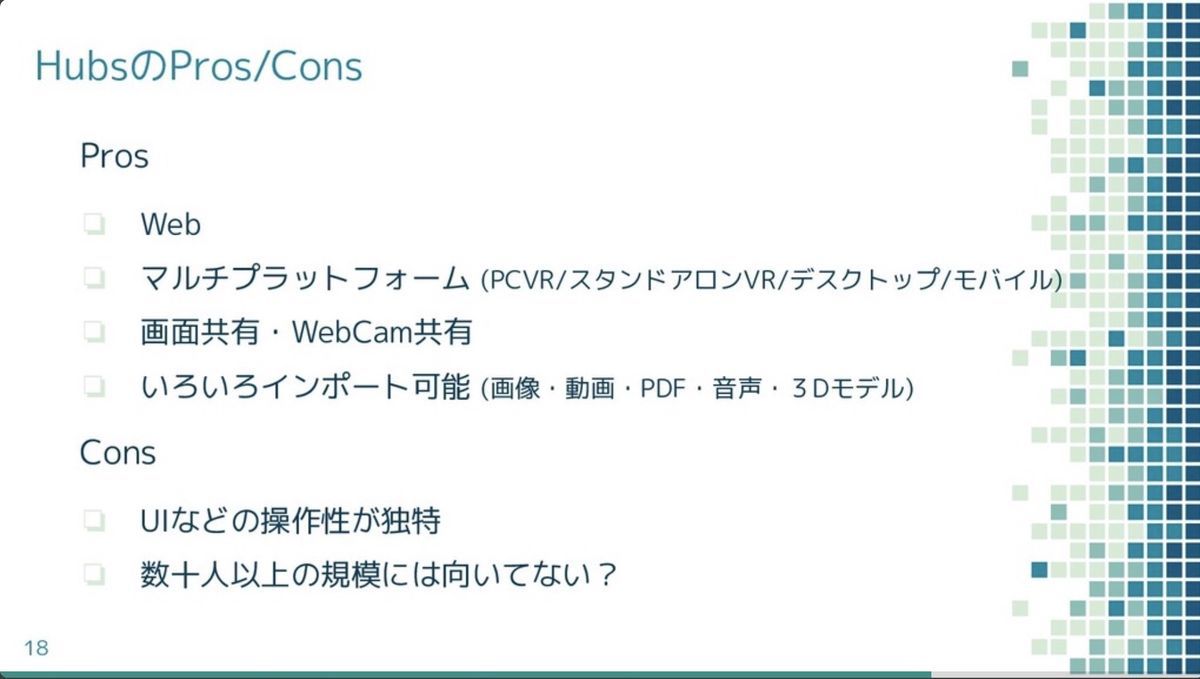

このVR空間とはMozillaが提供しているHubsというサービスです。clusterと同じように自分で空間を作ってその中でイベントなどができます。

Hubs - Private social VR in your web browser

なんとGithubでソースコードも公開されているので、自分用にHubsと同じ環境を1から作ることも可能です。

Hubsとclusterの違いについてもまとめられておりました。

これを見るとHubsの方がやれることが多い分、使い勝手や多人数同時接続はclusterの方が良さそうです。

2.7 Microsoft公式のHololensドキュメントを読もう!

発表者:トマシープ氏 @tomasheep

HoloLens2の公式ドキュメントの紹介です。

HoloLens2についてはデザインに関するドキュメントが多数まとめられており、HoloLens2固有のコンテンツのドキュメントも4つあるようです。

ドキュメントについて、原則英語で書かれていますが、ページ下部から日本語に変更できます。しかし、これはMicrosoftの機械翻訳がかかるだけなので見づらいかもしれないとのことでした。

ちなみに、トマシープさんはUnity、AR/VRのブログ記事を多数書かれております。私も時々参考にさせていただいております。

2.8 KumaMCNの紹介

発表者:@sotongshi

センサーやデバイスが好きな人が集まるコミュニティです。2016年に設立され、年間30回近いイベントを開催しているそうです。

詳しくはこちらをご参考ください。

2.9 HoloLensでSF世界を作ろう

発表者:ホロ元 氏 @HoloMotoRanger

ホロ元さんは、HoloLens、Unity関係の勉強記録を多数ブログに書かれております。今回はその知見からMRTKStandardShader、PulsShader、AzureKinect

について説明されていました。

(すいません、ちょうどこのとき子どもの対応で離席してて詳細が聴けませんでした。。)

個別のお話はこちらのブログにまとめられていますので、詳細ご確認ください。

2.10 Azure Spatial Anchors 入門

発表者:ちょまど氏 @chomado

www.slideshare.net

Azure Spatial Anchors とは、空間情報をAzureで管理して、HoloLensに限らずiOS、AndroidなどでもAR(MR)を共有できる仕組みです。

発表では概要、仕組みがわかりやすく説明されていました。詳しくはこちらに書かれています。

出たばかりなのでもう変わっているかもしれませんが、以前試した記事を参考までに貼っておきます。

2.11 これからはじめるAzure Kinect

発表者:杉浦 司氏 @UnaNancyOwen

AzureKinectの概要を丁寧に解説されています。

・AzureKinectはWindowsだけでなくLinuxでも動く

・CPUアーキテクチャとしてARMもサポートした

・C++で書くが、C#もサポートし始めている

私はKinectV2を少し使っただけなのでセンサー関係はあまり詳しくないですが、発表がとてもわかりやすかったのでAzureKinectでできそうなことがなんとなくわかりました。

2.12 HoloLens2 TutorialをMobileARで動かす

発表者:宮浦恭弘氏 @takabrz1

www.slideshare.net

HoloLens2向けのMRTK v2 ですが、AR Foundationの対応が試験的に入り始めています。AR Foundationとは、iOS、Android固有のARエンジンをUnityでクロスプラットフォーム対応する仕組みです。そのため、MRTKをAndroidで動かすということも可能になります。

今回の講演では、MRTKv2を使ったサンプルアプリをAndroidスマートフォンで動かすデモを紹介されていました。詳細は下記に書かれているとのことです。

2.13 Special Session!「MRTK's recent updates」

発表者:Yoon Park氏

Yoonさんは、MicrosoftでUXデザイナーとして働いている方です。空間にテキストを表示、配置することに関心が高いとのことです。ご本人のMediumにも紹介されています。

MRTKのアップデートについてです。

以下の画像はGithubのReadmeに書かれたものの一部です。講演ではButton、Bounding Box、Solverなどのほか、画像には含まれていませんがHand Menu、TaptoPlaceなど、多数の機能を動画付きで解説していただきました。

3. (2020/4/24 追記) clusterで数百人規模のイベントに参加したときの気付き事項

以前にもあったのかもしれませんが、300人近くが参加するclusterのイベントに参加したのは初めてでした。また、今回の冒頭のように、スタッフの方が複数壇上でお話されるのも初めてでした。

今後、少なくともしばらくの間はイベント開催がオンラインになりそうなので、今回参加して思ったことを書き出しておきます。

・複数の人がマイクを使うと、マイク音声がうまく伝わらないことがある

・スタッフ側のアバターが動くと、レンダリングがうまくいかず、瞬間移動みたいになったことがある

・スマートフォンで動かすとかなり熱かった

・HMDよりはPCの方が実況しやすいかも

これは@ikkouさんも言及されていました。私は聴きながらこの記事を書いていたので、HMDは付けていませんでした。

ライブに関しては仮に普段は VR HMD を片付けていたとしても引っ張り出してきて VR モードで観る価値は存分にあると思う反面、カンファレンス系イベントはデスクトップモードあるいはスマホアプリで必要十分だと感じるのがここ最近の持論です。

— ikkou / いっこう (@ikkou) April 22, 2020

何よりその方が実況が捗る……!! https://t.co/JBVlf5PTCZ

・Youtubeライブ配信と合わせると、帯域がかなり逼迫し不安定になる?

以前、AR輪読会というイベントがあり、ここでもclusterとYouTube配信を併用しました。しかし、そのときはそこまで遅延などはなかったように思います。clusterの同時接続者が多いと、どうしても不安定になるのかもしれません。

なお、先ほど見つけたのですが、発表者の1人の@tomasheepさんが、clusterで発表するための準備について詳しくまとめられていました。

VR空間で発表を考えている方にはお勧めですね。

4. おわりに

13個の発表があって、かなり内容が濃かったですが、最近イベントに参加できてなかったのでよい刺激になりました。

いくつか興味深い技術もあったので、機会あれば個別に試してみたいと思います。